De essentiële rol van XML sitemaps

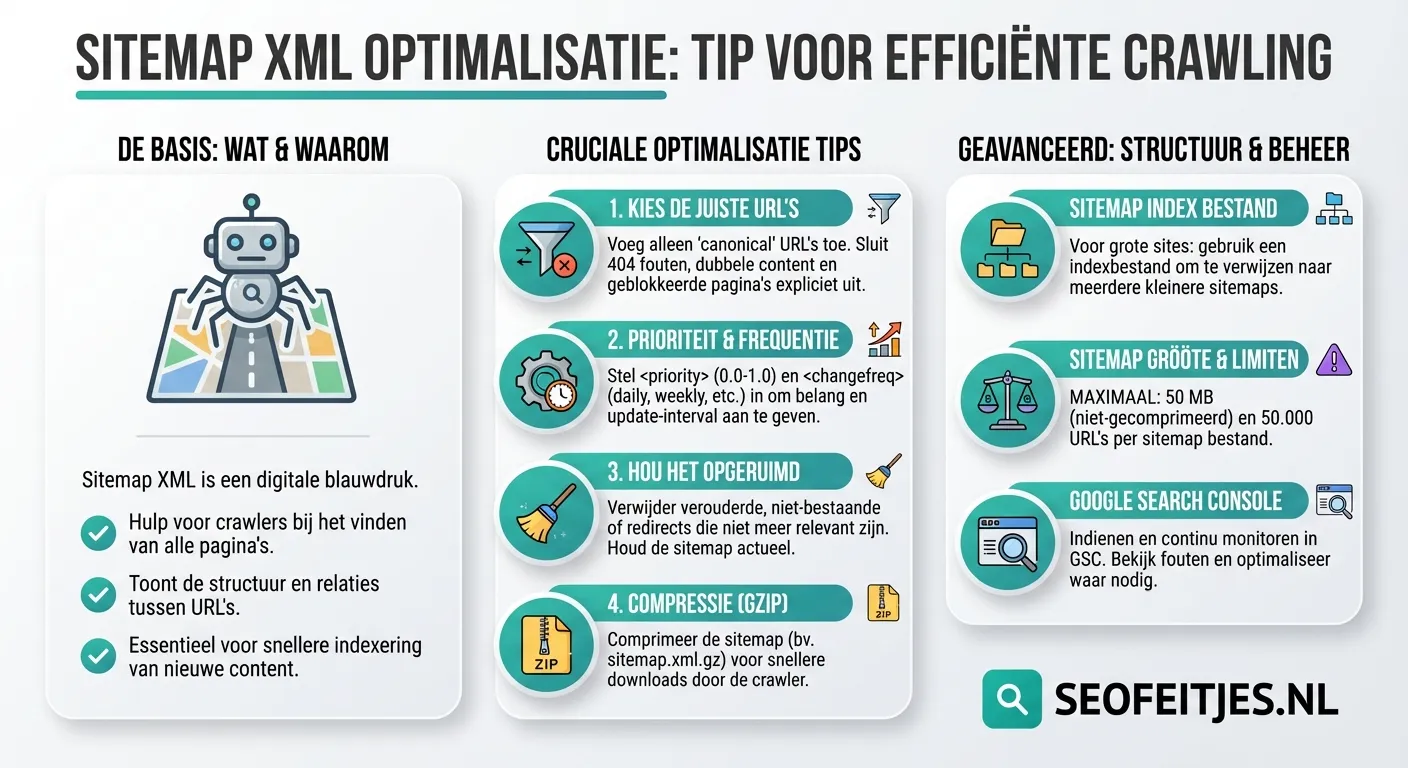

Een XML sitemap vervult een cruciale functie in het moderne SEO-landschap door zoekmachines te helpen bij het efficiënt crawlen en indexeren van websites. Deze gestructureerde bestanden bevatten niet alleen een overzicht van alle belangrijke URL's op een website, maar bieden tevens essentiële metadata zoals laatste wijzigingsdatum, updatefrequentie en prioriteitsinstellingen. Hoewel sommige website-eigenaren de impact van een XML sitemap onderschatten, toont onderzoek aan dat een goed geoptimaliseerde sitemap het crawlingproces aanzienlijk kan versnellen.

In de praktijk fungeert een XML sitemap als een gedetailleerde routekaart voor zoekmachinecrawlers, waarbij het proces nauw samenhangt met interne linkstructuur optimaliseren voor betere crawling. Terwijl interne links de natuurlijke navigatiestructuur vormen, biedt de XML sitemap een direct pad naar alle relevante content. Bovendien helpt deze aanpak vooral bij het ontdekken van pagina's die diep in de websitestructuur verborgen zitten of weinig interne links ontvangen.

Google's documentatie benadrukt het belang van XML sitemaps specifiek voor grote en complexe websites. Volgens Google's richtlijnen spelen sitemaps een vitale rol bij het efficiënt beheren van het crawlbudget voor grote websites. Daarnaast helpen ze bij het sneller indexeren van nieuwe of bijgewerkte content, wat vooral waardevol is voor dynamische websites met frequent veranderende inhoud.

Technische vereisten voor optimale sitemap structuur

De technische implementatie van een XML sitemap vereist nauwkeurige aandacht voor detail en conformiteit aan de officiële protocollen. Een correcte sitemap begint met de juiste XML-declaratie en namespace-definities, gevolgd door een gestructureerde lijst van URL-elementen. Daarnaast moet elke URL voorzien zijn van aanvullende tags die zoekmachines helpen bij het bepalen van crawling- en indexeringsprioriteiten.

Voor grote websites is het essentieel om rekening te houden met de technische limieten die Google stelt. Een individueel sitemap-bestand mag niet groter zijn dan 50MB (ongecomprimeerd) en maximaal 50.000 URL's bevatten. Bij overschrijding van deze grenzen dient men gebruik te maken van een sitemap-index, die verwijst naar meerdere subsitemaps. Deze opdeling zorgt niet alleen voor betere verwerking door zoekmachines, maar maakt ook gerichte monitoring van specifieke websitesecties mogelijk.

De integratie met robots.txt en meta robots tags voor crawl- en indexbeheer vormt een cruciaal onderdeel van de technische optimalisatie. Het is belangrijk om de sitemap-locatie correct te declareren in het robots.txt-bestand, terwijl tegelijkertijd consistentie wordt bewaard tussen meta robots-instructies en sitemap-inclusies. Bovendien dragen gecomprimeerde sitemaps (gebruikmakend van GZIP) bij aan snellere verwerking en efficiënter bandbreedtegebruik.

Optimalisatie van XML sitemap content

Bij het optimaliseren van sitemap-content staat selectiviteit voorop. Niet elke URL op een website verdient een plek in de XML sitemap. Het proces begint met een grondige analyse van welke pagina's daadwerkelijk waardevol zijn voor indexering. Hierbij speelt de kwaliteit van de content een doorslaggevende rol, evenals de toegevoegde waarde voor gebruikers en zoekmachines.

De prioritering binnen een XML sitemap gebeurt door middel van specifieke attributen zoals lastmod, changefreq en priority. Deze metadata-elementen helpen zoekmachines bij het maken van geïnformeerde beslissingen over crawlingfrequentie en -prioriteit. Hoewel Google heeft aangegeven dat het priority-attribuut niet direct de rankingpositie beïnvloedt, draagt het wel bij aan een efficiëntere verdeling van het crawlbudget.

Het is cruciaal om de sitemap regelmatig bij te werken en te synchroniseren met de actuele websitestructuur. Verouderde of onjuiste informatie in een sitemap kan leiden tot verspilling van crawlbudget en verminderde crawlingefficiëntie. Daarom verdient het aanbeveling om een geautomatiseerd systeem te implementeren dat de sitemap dynamisch bijwerkt wanneer er contentwijzigingen plaatsvinden.

Monitoring en prestatie-optimalisatie

Een effectieve monitoring-strategie vormt de basis voor continue optimalisatie van XML sitemaps. Google Search Console biedt hiervoor waardevolle inzichten in de verwerking en acceptatie van ingediende sitemaps. Het dashboard toont niet alleen het aantal ingediende en geïndexeerde URL's, maar signaleert ook eventuele fouten of waarschuwingen die aandacht vereisen.

De analyse van crawlingstatistieken helpt bij het identificeren van patronen en mogelijke verbeterpunten. Door regelmatig de crawlingfrequentie en -diepte te monitoren, kunnen webmasters bepalen of de sitemap effectief bijdraagt aan de gewenste indexering. Bovendien maken deze inzichten het mogelijk om de impact van sitemap-optimalisaties te meten en waar nodig bij te sturen.

Het is essentieel om crawlingproblemen proactief aan te pakken. Wanneer bepaalde URL's consistent niet worden gecrawld of geïndexeerd, kan dit wijzen op onderliggende technische problemen of kwaliteitsissues. Door deze signalen tijdig op te pikken en te adresseren, voorkomt men dat waardevolle content onopgemerkt blijft voor zoekmachines.

Geavanceerde sitemap strategieën

Voor websites met verschillende contenttypen bieden gespecialiseerde sitemaps aanvullende optimalisatiemogelijkheden. Video-sitemaps bijvoorbeeld, kunnen extra metadata bevatten zoals thumbnails, speelduur en leeftijdsclassificatie, wat de zichtbaarheid in videozoekresultaten bevordert. Hetzelfde geldt voor news-sitemaps en image-sitemaps, die specifieke attributen ondersteunen voor hun respectievelijke contenttypes.

De implementatie van dynamische sitemap-generatie vormt een belangrijke stap naar verdere automatisering. Door gebruik te maken van server-side scripts of gespecialiseerde CMS-plugins, kunnen sitemaps automatisch worden bijgewerkt zodra er contentwijzigingen plaatsvinden. Deze real-time synchronisatie zorgt ervoor dat zoekmachines altijd toegang hebben tot de meest actuele informatie.

Het gebruik van conditionale logica in sitemap-generatie kan de efficiëntie verder verhogen. Door bijvoorbeeld alleen pagina's met een bepaalde engagement-score of kwaliteitsscore op te nemen, wordt het crawlbudget gerichter ingezet. Deze strategische benadering zorgt ervoor dat zoekmachines prioriteit geven aan de meest waardevolle content.

Toekomstbestendige sitemap optimalisatie

De evolutie van zoekmachinealgoritmes en crawlingtechnologieën vraagt om een vooruitziende blik bij sitemap-optimalisatie. Machine learning speelt een steeds grotere rol in hoe Google crawlingprioriteiten bepaalt, wat nieuwe mogelijkheden biedt voor intelligente sitemap-structurering. Het anticiperen op deze ontwikkelingen helpt websites hun competitieve voordeel te behouden.

De integratie van structured data met XML sitemaps vormt een veelbelovende ontwikkelingsrichting. Door schema.org-markup te koppelen aan sitemap-entries, kunnen zoekmachines nog beter begrijpen wat de context en relevantie van specifieke pagina's is. Deze verrijkte metadata draagt bij aan efficiëntere crawling en potentieel betere presentatie in zoekresultaten.

Het belang van mobile-first indexering reflecteert zich ook in moderne sitemap-strategieën. Websites met verschillende URL-versies voor mobiel en desktop moeten zorgen voor correcte canonical-verwijzingen in hun sitemaps. Deze afstemming voorkomt verwarring bij zoekmachines en ondersteunt een coherente indexeringsstrategie.